सोशल मीडिया पर एक वीडियो तेजी से वायरल हो रहा है, जिसमें दावा किया जा रहा है कि एक मुस्लिम होटल संचालक खाने में थूककर ग्राहकों को परोस रहा है। इस वीडियो को शेयर करते हुए कई यूजर्स मुस्लिम समुदाय की आलोचना कर रहे हैं और आपत्तिजनक टिप्पणियां कर रहे हैं।

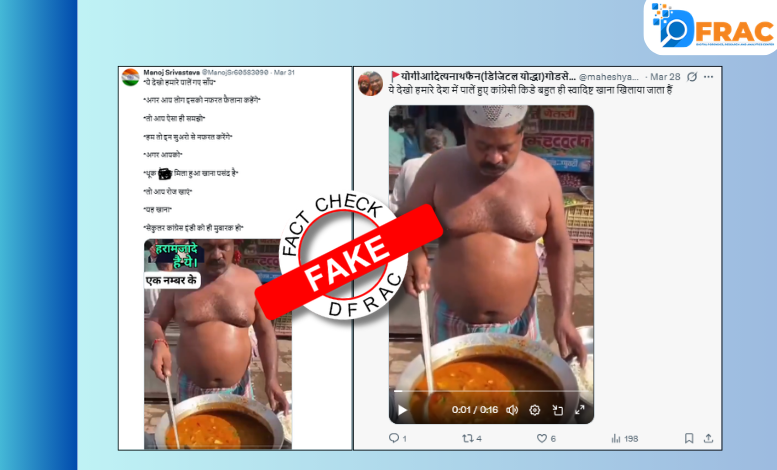

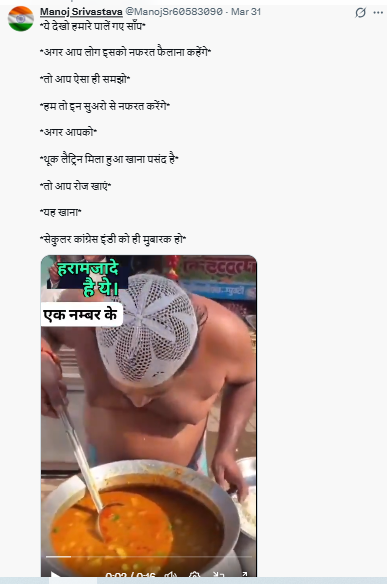

सोशल मीडिया पर मनोज श्रीवास्तव नामक यूजर ने वीडियो को शेयर करते हुए लिखा, ‘ये देखो हमारे पालें गए साँप* *अगर आप लोग इसको नफरत फैलाना कहेंगे* *तो आप ऐसा ही समझो* *हम तो इन सुअरो से नफरत करेंगे* *अगर आपको* *थूक लैट्रिन मिला हुआ खाना पसंद है* *तो आप रोज खाएं* *यह खाना* *सेकुलर कांग्रेस इंडी को ही मुबारक हो*’

इसके अलावा, योगीआदित्यनाथफैन(डिजिटल योद्धा)गोडसे का भक्त और Vinod kumar Singh Raikwar सहित कई अन्य यूजर्स द्वारा भी इस वीडियो को ऐसे ही दावे के साथ शेयर किया गया है।

फैक्ट चेकः

DFRAC की टीम ने वायरल वीडियो की जांच में पाया कि यह किसी होटल का वास्तविक वीडियो नहीं है, बल्कि इस वीडियो को आर्टिफिशयल इंटेलिजेंस (AI) द्वारा बनाया गया है। हमारी टीम ने वीडियो को गौर से देखने पर पाया कि होटल के बोर्ड पर कुछ शब्द लिखे गए हैं, जो किसी भी भारतीय भाषा के नहीं हैं। आमतौर पर ऐसे शब्द एआई-जनरेटेड वीडियो में देखने को मिलते हैं, जहां शब्द बिल्कुल भी स्पष्ट नहीं होते हैं।

वहीं, वीडियो में यह भी देखा जा सकता है कि होटल संचालक ग्राहक के सामने ही थाली में थूककर खाना परोसता है, और आश्चर्यजनक रूप से ग्राहक उसे स्वीकार भी कर लेता है, जो सामान्य परिस्थितियों में किसी भी ग्राहक द्वारा ऐसा नहीं किया जाएगा।

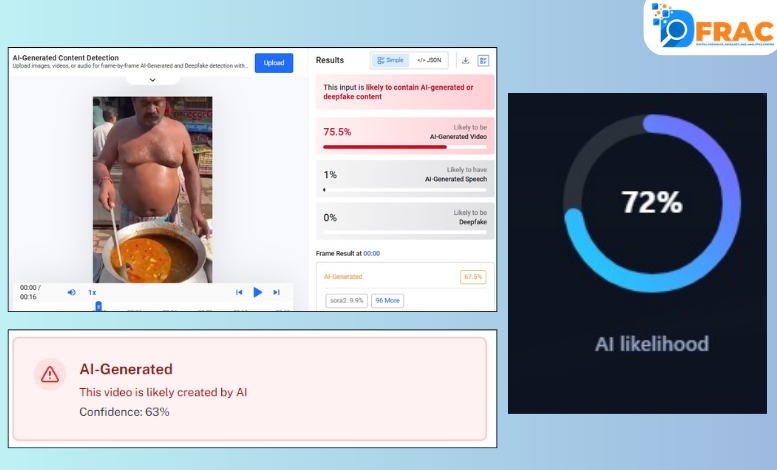

इसके बाद आगे की जांच के लिए हमारी टीम ने वायरल वीडियो की जांच एआई डिटेक्टर टूल्स हाइव मॉडरेशन, detectvideo.ai और undetectable.ai पर की। इन तीनों की जांच में परिणाम सामने आया कि वायरल वीडियो के एआई-जनरेटेड होने के चांस 70 प्रतिशत से ज्यादा हैं।

वहीं हमने इस वीडियो के बारे में विस्तृत जानकारी के लिए एआई विशेषज्ञ मयंक शर्मा से संपर्क किया। मयंक ने हमें बताया कि यह वीडियो वास्तविक घटना का प्रमाण नहीं है, बल्कि इसे AI टूल्स या एडिटिंग तकनीकों की मदद से बनाया गया है। मयंक के अनुसार ऑब्जेक्ट्स की मूवमेंट स्मूद होने के बजाय “फ्लोट” या अचानक बदलती हुई नजर आती है। यह AI वीडियो जनरेशन की आम खामी है।

निष्कर्षः

DFRAC के फैक्ट चेक से साफ है कि सोशल मीडिया पर वायरल हो रहा वीडियो एआई-जनरेटेड है और इस वीडियो का वास्तविकता से कोई संबंध नहीं है। इसलिए यूजर्स का दावा फेक है।